文|探客Tanker 王颖

编辑|蛋总

一直以来,“鉴黄师”被认为是一种神秘且高薪的职业,很多普通人都对这个职业充满了好奇,甚至有人想做个兼职,以为轻轻松松就能赚钱,但这个职业真的是“钱多事少”吗?

事实上,“鉴黄师”是自20世纪80年代起,公安部应“扫黄打非”需求而诞生的岗位,当时的鉴黄师通常由女民警来担任,对涉案的淫秽物品进行分类分级。

在信息泛滥的互联网时代,我们所说的“鉴黄师”的概念已经随着内容形态的多样化而发生了改变——如今的“鉴黄师”更多的是指各平台上的审核员,他们负责对违规的视频、音频、图片以及文字进行审核和处理,而这些违规内容包括色情、涉暴、涉黑和涉政等等。

据「探客Tanker」了解,大部分平台上的鉴黄师每天可能要审核五六万字的小说或者几百条音视频内容,但这些数字对每天产生的海量网络数据来说,连“九牛一毛”都算不上。于是,一种新的AI应用出现了——AI鉴黄师。

鉴黄师每天的工作就是合理合法地“看片儿”吗?鉴黄师真的能月入十万?AI鉴黄能否替代人工?带着这些疑问,「探客Tanker」和一些仍在从事这份工作以及已经选择转行的人进行了深入交流。

1、事多钱少,还可能随时被换掉

严格来说,每家公司都没有设立“鉴黄师”这个岗位,他们都被归属于“内容审核部门”,而审核部门也分文字审核、视频审核、图片审核以及音频审核。

鉴黄师这个职业之所以显得神秘,主要原因是他们的审核内容很多是“见不得光”的,比如其他职业的人写简历时可以把作品集贴上去,但鉴黄师肯定不行。

此外,鉴黄师所处理的很多数据是无法公开的,他们的工作培训也是在一个断网“小黑屋”里进行,因为培训内容会涉及某些禁忌词汇,这些词汇的出现和传播本身就是违法行为。此前,就有审核员在网吧传输工作文件而被网警调查的事件。

“2016年我毕业时,进入互联网行业只有两个基础渠道,一是审核,二是客服,我就是从做审核开始进入这个行业的。在审核工作中,色情可能是大头,还有暴力血腥甚至涉政等内容,这些都属于内容安全方面。”有三年经验的前鉴黄师刘利(化名)向「探客Tanker」介绍。

他刚入这一行时,上海的工资是在3500-4500元之间,他想要晋升的话,也只有从执行审核到审核主管这一条路,“不仅工资涨不了多少还要为审核错误背锅,说白了升主管的一部分工资就是给你背锅的钱。”刘利无奈地说,“网传的高收入一般是算法工程师的岗位,还包括阿里、腾讯这些大公司会做一些项目训练AI,他们需要大量的审核员去测试系统,这种项目的测试人员收入也会相对高一些。”

事实上,鉴黄工作对审核人员来说是非常枯燥的,它并不是什么高难度的技术工种,却需要审核员一直盯着电脑屏幕,在数不清的文字和视频中找出违规内容。

这些违规内容不但涉及色情,还包括暴力、敏感词等等,任何人长期对着这些不健康的内容都会出现生理和心理上的不适。甚至有部分审核员因此患上了精神疾病,极端情况下还有人因不堪忍受这种痛苦而选择自杀。

今年4月,一位Facebook的内容审核员在离职前,公开了企业内部审核制度和员工待遇方面的问题,引发了网民们的关注。作为内容审核员,他们需要在工作时间内连续观看暴力、色情和虐待等等常人无法接受的画面,但公司却没有设立可为他们进行心理疏导的相关岗位,而且这些员工的工资通常非常低。

“我在广州的工资底薪是2300元,加上绩效每个月到手只有四五千。真的没有网传的那么多。”一位“不知名的前鉴黄师甲”告诉「探客Tanker」。

“不知名的前鉴黄师甲”每天要审核3000多章小说,600多个小程序,最难的是要面对重复性劳动下的精神麻木状态,还有随时可能被替换的心理弱势,“我经常会感觉自己像个机器,而且这份工作除了相同途径的管理层基本没有什么上升渠道。”

一般来说,企业内部除了自己的审核部门外,还会将大部分审核工作外包出去,这位“不知名的前鉴黄师甲”就是做阿里文娱和腾讯小程序外包审核工作的。因为承接外包并不会完全具体到某个平台,所以很多审核员会同时负责不同企业、不同内容的审核。

据「探客Tanker」获悉,与外包公司承接业务不同,企业内部的审核员要审核的范围其实更广,平台内的视频和图文都要审核,但在数量上就没有外包公司规定的那么细致,通常情况下只要在规定的时间段内不出现存量就可以。

“如果平台内容的存量少,那我们的工作量是没有规定的,但像B站、头条这种每天有成千上万条内容的平台一般都会给审核员规定工作量。”刘利告诉「探客Tanker」。

小白是个萌妹子,她的工作是负责给色情图片分类,每天大概要审核5000张图片。

“我们公司大部分的审核员都是20出头的年轻人,男女比例在1:4左右。审核时会有多轮筛选,会重复清洗数据,如果发现没被审核到的内容,公司内部会给予一定金额的惩罚。”小白向「探客Tanker」介绍。

纪录片《网络审查员》还原了这个职业背后一些令人无奈的真相。洁净的网络环境背后是一群时薪只有1美元的廉价劳动力,他们每天对着屏幕十几个小时,看到的都是裸体、尸体和血腥等内容,即使有人不堪忍受也无法离开这个行业,因为他们需要这份收入,而且还有巨额的违约金束缚。

也许从事这份工作的人并不都处于纪录片中的极端情况,但他们的工作无疑会对身心健康造成某些伤害。也许,AI的出现真的能解决这些问题,让这些压力转嫁到机器上去。

2、AI高效精准,但难取代人工

互联网的诞生让信息的获取变得唾手可得,随着数据传输能力和网络连接能力的提升,这种唾手可得已经开始演变成大量信息的灌输。当前,网络世界鱼龙混杂,各类信息良莠不齐,智能筛选和屏蔽功能已经成为内容平台的刚需。

“2016年我刚入行时,业内就已经开始采用AI来审核了,一般情况下都是AI先去审一遍,然后人工再查一遍。比如某些热门内容或需要上首页的内容,会有专门的人员再去检查。假设哪部分或哪个帖子被举报得比较多,也会有专人去审核。”刘利表示。

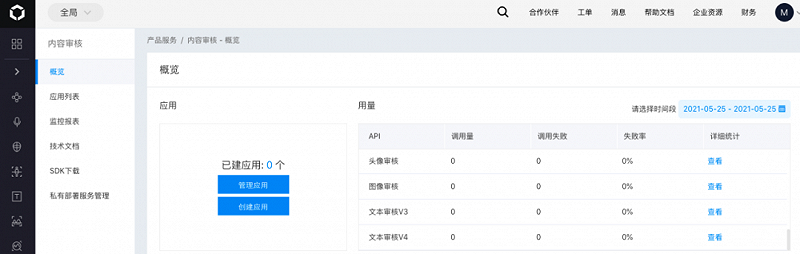

2018年,阿里巴巴就曾介绍过他们在AI鉴黄研究上取得的进展。当时,阿里巴巴安全部算法专家称,他们的AI鉴黄模型已经可以对图片、语音和视频进行全面审核,甚至可以对英文、日文和俄文的外语进行识别,审核效率比人工高几百倍。

今年4月29日,在首都网络安全日活动现场,阿里高级安全专家屏翰介绍了AI鉴黄师技术的最新进展,不仅能识别语音、图片和视频中的涉黄、广告等违规信息,还能精准识别“多人运动”、“王者五排”这类“黑话”。

“具体而言,在审核内容中,最难的就是标准问题,很多内容的‘违规标准’的界定是模糊的,遇到一个新例子就会更新一个新标准。很多人会有千奇百怪的手法规避违禁点,比如几根蜡烛、几条线表示某些违禁点,或者一些模棱两可的词。遇到这些比较难判断的,我都会汇报上级,我们一起开会讨论细化标准。”“不知名的前鉴黄师甲”对「探客Tanker」表示。

刘利也提到,“一些色情网站会发一些广告内容,这些AI很难审核出来,比如邀请加微信,微信这两个字就可能变成VX、wei信等等不同形式,各种相似的变体非常多,相当于要给AI穷举出所有方式,这很难做到。”

近年来,随着AI审核能力的不断提升也给审核员减轻了不少工作压力,对于这些越来越隐晦的手段也能更快识别。

“AI鉴黄是基于大量图片的分类进行学习,还可以通过特征检索对局部内容进行分析,对于裸露的部位、面积判断是否违规。现在的智能审核平台已经可以对文本、图片、视频、音频做分类检测,准确率在99%以上。除了色情内容,一些暴力、恐怖、政治敏感的内容也都能检测出来。”AI算法工程师李智告诉「探客Tanker」。

此外,百度也较早开始了技术识别违规内容的尝试,2017年百度就开始人机合作的审核模式,百度网盘大量内容“被和谐”的事情还曾引起了一阵热议。现在,百度大脑的AI开放平台已经可以覆盖多维度的审核,包括色情、暴恐、政治和广告等等。

除了图片和视频方面,腾讯云还推出了基于音频的鉴黄系统。据「探客Tanker」了解,腾讯云的音频鉴黄系统每天能处理上亿条音频,准确率超过95%。

“如果审核员发现某些内容出现的频率很高,可以向算法工程师反映,通过算法帮助筛选,这也能节省人力成本。总体来说人工审核更主观,有些暗示性的也可以被筛掉,但是AI可能会更死板。现在就是AI和我们同时工作,正因为AI不能完全替代人工,所以才会有人工审核员一直存在。”鉴黄师七七对「探客Tanker」表示。

基于现在海量的信息,对内容平台来说AI的参与肯定能提升效率,无论对平台内容还是企业收益都更有好处。但从鉴黄师的角度来看,即使人工审核都很难做到完全准确,AI就更不用说了,现在经过AI筛选的内容仍然需要审核员把关,如果把这项工作完全交给AI,平台肯定会出问题。

3、标准化与人性化,都有待完善

客观来看,AI鉴黄和传统的审核不同,它包括台前幕后两个岗位,除了台前的人工审核员外,还有幕后提供算法技术的工程师们。

“工程师要做的是收集数据、训练模型,还要对模型的准确度负责,如果出现了识别错误还要继续对系统进行迭代。审核员在对AI筛选后的内容进行审核时,若发现了大量的错误需要向我们反馈,然后再由工程师继续调整模型。不过现在技术已经相对成熟了,基本没有大的错误出现。”李智对「探客Tanker」表示。

这也衍生出另一个问题,以微博为例,我们有时会在评论区看到一些违规内容,有的是图片,有的是文字,还有的是链接。如果AI已经能在很大程度上实现准确审核,为何还会出现这些违规内容?

“从理性层面上看,AI技术完全可以做到精准审核了,但由于平台担忧大量流失用户,比如AI把‘小说’两个字标记出来,那就会有很多误伤,所有的小说链接都会失效,那很多原创用户也不能发布自己的内容了。为了网站的流量和用户体验,很多平台宁愿多加人工去审核判断,也要避免使用AI误伤造成用户的流失。”刘利对「探客Tanker」坦言。

此外,AI鉴黄还存在一些问题,比如刘利提到的,“AI会把一些有明显问题的内容筛查出来或者直接删掉,但也有可能会误伤,比如‘色情’这两个字是关键词,但某些语句中存在这两个字也不代表它的内容是违规的,例如一些论文,或者‘角色情报’这四个字,AI就会把它标记出来,为了避免这种误伤,还是需要人工再去审核恢复。”

在和「探客Tanker」的交谈中,鉴黄师们不断提到的难点基本都在于:工作内容没有统一的判断标准,文学作品和艺术品中也会有常规意义上不同的标准,而且不同时期的违禁词都是不同的,这对AI来说,也是具有挑战的。

即便AI鉴黄技术目前还不够完善,但总体而言,它的存在是必要的——除了提升审核效率且让网络环境更加清朗外,AI对鉴黄师的心理保护也非常重要。

这个职业的神秘色彩背后其实包含了太多问题,很多鉴黄师直言:“想要多点绩效就得多审核量,下班后我看世界都是绿色的。这个岗位硬性要求不多,最重要的是鉴黄师本人的承受能力。”

“我是学服装的,毕业刚好赶上中美贸易战,行业不景气就想找个有兴趣的工作试试,做了两年半,现在已经回家就业了,下一步准备考公职。”“不知名的前鉴黄师甲”颇为无奈地告诉「探客Tanker」。

“这几年,根据学历和能力以及是否使用到外语,鉴黄师的工资大概在4000到10000之间。只做执行是非常累的,每天重复点击成千上万次,不仅枯燥而且很考验心理承受能力。最难的是还要承担一定风险,如果放过一条内容导致整个网站或产品被举报,只能自己承担责任,平台大概率是不会保你的,现在已经很少有人愿意来做这份工作了,如果AI能做的更多,公司也相应调整我们的KPI和绩效也许是个好事。”仍在从事这份工作的七七对「探客Tanker」说。

毫无疑问,AI鉴黄技术的出现,确实让鉴黄师们的工作效率提高了,同时也让这个职业“出圈”了——人们开始看到这些为大众维护清明网络环境的从业者与新技术。而有了AI技术的加持,网络平台的审核肯定会更加严格,我们所处的网络世界也会更加安全、干净。